Digitalsignalübertragung/Fehlerwahrscheinlichkeit bei Basisbandübertragung: Unterschied zwischen den Versionen

Ayush (Diskussion | Beiträge) |

Ayush (Diskussion | Beiträge) |

||

| Zeile 29: | Zeile 29: | ||

Die obige Definition der Bitfehlerwahrscheinlichkeit gilt unabhängig davon, ob es statistische Bindungen innerhalb der Fehlerfolge 〈<i>e<sub>ν</sub></i>〉 gibt oder nicht. Je nachdem ist der Aufwand zur Berechnung von <i>p</i><sub>B</sub> unterschiedlich groß und bei einer Systemsimulation müssen unterschiedliche digitale Kanalmodelle herangezogen werden. | Die obige Definition der Bitfehlerwahrscheinlichkeit gilt unabhängig davon, ob es statistische Bindungen innerhalb der Fehlerfolge 〈<i>e<sub>ν</sub></i>〉 gibt oder nicht. Je nachdem ist der Aufwand zur Berechnung von <i>p</i><sub>B</sub> unterschiedlich groß und bei einer Systemsimulation müssen unterschiedliche digitale Kanalmodelle herangezogen werden. | ||

Im Kapitel 5 wird gezeigt, dass das sog. BSC–Modell (<i>Binary Symmetrical Channel</i>) statistisch unabhängige Fehler liefert, während für die Beschreibung von Bündelfehlerkanälen auf die Modelle von Gilbert–Elliott: .: Capacity of Burst–Noise Channel, In: Bell Syst. Techn. J. Vol. 39, 1960, pp. 1253–1266 and McCullough : The Binary Regenerative Channel, In: Bell Syst. Techn. J. (47), 1968 zurückgegriffen werden muss. | Im Kapitel 5 wird gezeigt, dass das sog. BSC–Modell (<i>Binary Symmetrical Channel</i>) statistisch unabhängige Fehler liefert, während für die Beschreibung von Bündelfehlerkanälen auf die Modelle von Gilbert–Elliott: .: Capacity of Burst–Noise Channel, In: Bell Syst. Techn. J. Vol. 39, 1960, pp. 1253–1266 and McCullough : The Binary Regenerative Channel, In: Bell Syst. Techn. J. (47), 1968 zurückgegriffen werden muss. | ||

| + | |||

| + | |||

| + | == Definition der Bitfehlerquote (1) == | ||

| + | <br> | ||

| + | Die Bitfehlerwahrscheinlichkeit <i>p</i><sub>B</sub> eignet sich zum Beispiel gut für die Konzipierung und Optimierung von Digitalsystemen. Diese ist eine <font color="#cc0000"><span style="font-weight: bold;">Apriori-Kenngröße</span></font>, die eine Vorhersage über das Fehlerverhalten eines Nachrichtensystems erlaubt, ohne dass dieses bereits realisiert sein muss. | ||

| + | Dagegen muss zur messtechnischen Erfassung der Qualität eines realisierten Systems oder bei einer Systemsimulation auf die Bitfehlerquote übergegangen werden, die durch den Vergleich von Quellen– und Sinkensymbolfolge ermittelt wird. Diese ist somit eine <font color="#cc0000"><span style="font-weight: bold;">Aposteriori-Kenngröße</span></font> des Systems. | ||

| + | {{Definition}}''':'''Die <font color="#cc0000"><span style="font-weight: bold;"><font color="#cc3300"> Bitfehlerquote</font> </span></font> (englisch: <i>Bit Error Rate</i>, BER) ist das Verhältnis aus der Anzahl <i>n</i><sub>B</sub>(<i>N</i>) der aufgetretenen Bitfehler (<i>υ<sub>ν</sub></i> ≠ <i>q<sub>ν</sub></i>) und der Anzahl <i>N</i> der insgesamt übertragenen Symbole: | ||

| + | <math>h_{\rm B}(N) = \frac{n_{\rm B}(N)}{N} \hspace{0.05cm}.</math> | ||

| + | Im Sinne der Wahrscheinlichkeitsrechnung stellt die Bitfehlerquote eine relative Häufigkeit dar; sie wird demzufolge auch <font color="#000000"><span style="font-weight: bold;"> Bitfehlerhäufigkeit </span></font> genannt.{{end}}<br> | ||

| + | |||

| + | Die Schreibweise <i>h</i><sub>B</sub>(<i>N</i>) soll deutlich machen, dass die per Messung oder durch Simulation ermittelte Bitfehlerquote signifikant von dem Parameter <i>N</i> – also der Anzahl der insgesamt übertragenen oder simulierten Symbole – abhängt. Nach den elementaren Gesetzen der Wahrscheinlichkeitsrechnung stimmt nur im Grenzfall <i>N</i> → ∞ die Aposteriori–Kenngröße <i>h</i><sub>B</sub> mit der Apriori–Kenngröße <i>p</i><sub>B</sub> exakt überein.<br><br> | ||

| + | Der Zusammenhang zwischen Wahrscheinlichkeit und relativer Häufigkeit wird in einem Lernvideo zum Buch „Stochastische Signaltheorie” verdeutlicht:<br> | ||

| + | [https://intern.lntwww.de/cgi-bin/extern/uni.pl?uno=hyperlink&due=block&b_id=848&hyperlink_typ=block_verweis&hyperlink_fenstergroesse=blockverweis_gross Das Bernoullische Gesetz der großen Zahlen] (Dateigröße: 1.97 MB, Dauer: 4:25)<br><br> | ||

| + | Für die nachfolgende Herleitung wird das <font color="#cc0000"><span style="font-weight: bold;">BSC–Modell</span></font> zugrunde gelegt, das in Kapitel 5.2 im Detail beschrieben wird. Jedes einzelne Bit wird mit der Wahrscheinlichkeit <i>p</i> = Pr(<i>υ<sub>ν</sub></i> ≠ <i>q<sub>ν</sub></i>) = Pr(<i>e</i><sub>ν</sub> = 1) verfälscht, unabhängig von den Fehlerwahrscheinlichkeiten der benachbarten Symbole. Die (mittlere) Bitfehlerwahrscheinlichkeit <i>p</i><sub>B</sub> ist somit ebenfalls gleich <i>p</i>. | ||

| + | |||

| + | |||

| + | |||

| + | |||

{{Display}} | {{Display}} | ||

Version vom 16. November 2016, 19:20 Uhr

Definition der Bitfehlerwahrscheinlichkeit

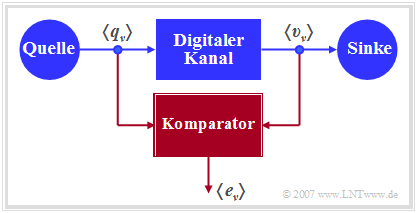

Die Grafik zeigt ein sehr einfaches, aber allgemeingültiges Modell eines binären Übertragungssystems.

Dieses lässt sich wie folgt charakterisieren:

- Die Quelle und die Sinke werden durch die beiden Binärfolgen 〈qν〉 und 〈υν〉 beschrieben.

- Das gesamte Übertragungsystem – bestehend aus Sender, Übertragungskanal inklusive Störungen und Empfänger – wird als „Black Box” mit binärem Ein– und Ausgang betrachtet.

- Dieser „Digitale Kanal” wird allein durch die Fehlerfolge 〈eν〉 charakterisiert. Bei fehlerfreier Übertragung des ν–ten Bits (υν = qν) gilt eν = 0, andernfalls (υν ≠ qν) wird eν = 1 gesetzt.

Diese statistische Größe ist das wichtigste Beurteilungskriterium eines jeden Digitalsystems.

Die Berechnung als Erwartungswert E[…..] gemäß dem ersten Teil der obigen Gleichung entspricht einer Scharmittelung über die Verfälschungswahrscheinlichkeit Pr(υν ≠ qν) des ν–ten Symbols, während die überstreichende Linie im rechten Teil eine Zeitmittelung kennzeichnet. Beide Berechnungsarten führen – unter der gerechtfertigten Annahme ergodischer Prozesse – zum gleichen Ergebnis, wie im Kapitel 4 des Buches „Stochastische Signaltheorie” gezeigt wurde.

Auch aus der Fehlerfolge 〈eν〉 lässt sich die Bitfehlerwahrscheinlichkeit als Erwartungswert bestimmen, wobei zu berücksichtigen ist, dass eν nur die Werte 0 und 1 annehmen kann:\[\it P_{\rm B} = \rm E[\rm Pr(\it e_{\nu}=\rm 1)]= {\rm E}[{\it e_{\nu}}]\hspace{0.05cm}.\] Die obige Definition der Bitfehlerwahrscheinlichkeit gilt unabhängig davon, ob es statistische Bindungen innerhalb der Fehlerfolge 〈eν〉 gibt oder nicht. Je nachdem ist der Aufwand zur Berechnung von pB unterschiedlich groß und bei einer Systemsimulation müssen unterschiedliche digitale Kanalmodelle herangezogen werden. Im Kapitel 5 wird gezeigt, dass das sog. BSC–Modell (Binary Symmetrical Channel) statistisch unabhängige Fehler liefert, während für die Beschreibung von Bündelfehlerkanälen auf die Modelle von Gilbert–Elliott: .: Capacity of Burst–Noise Channel, In: Bell Syst. Techn. J. Vol. 39, 1960, pp. 1253–1266 and McCullough : The Binary Regenerative Channel, In: Bell Syst. Techn. J. (47), 1968 zurückgegriffen werden muss.

Definition der Bitfehlerquote (1)

Die Bitfehlerwahrscheinlichkeit pB eignet sich zum Beispiel gut für die Konzipierung und Optimierung von Digitalsystemen. Diese ist eine Apriori-Kenngröße, die eine Vorhersage über das Fehlerverhalten eines Nachrichtensystems erlaubt, ohne dass dieses bereits realisiert sein muss.

Dagegen muss zur messtechnischen Erfassung der Qualität eines realisierten Systems oder bei einer Systemsimulation auf die Bitfehlerquote übergegangen werden, die durch den Vergleich von Quellen– und Sinkensymbolfolge ermittelt wird. Diese ist somit eine Aposteriori-Kenngröße des Systems.

Die Schreibweise hB(N) soll deutlich machen, dass die per Messung oder durch Simulation ermittelte Bitfehlerquote signifikant von dem Parameter N – also der Anzahl der insgesamt übertragenen oder simulierten Symbole – abhängt. Nach den elementaren Gesetzen der Wahrscheinlichkeitsrechnung stimmt nur im Grenzfall N → ∞ die Aposteriori–Kenngröße hB mit der Apriori–Kenngröße pB exakt überein.

Der Zusammenhang zwischen Wahrscheinlichkeit und relativer Häufigkeit wird in einem Lernvideo zum Buch „Stochastische Signaltheorie” verdeutlicht:

Das Bernoullische Gesetz der großen Zahlen (Dateigröße: 1.97 MB, Dauer: 4:25)

Für die nachfolgende Herleitung wird das BSC–Modell zugrunde gelegt, das in Kapitel 5.2 im Detail beschrieben wird. Jedes einzelne Bit wird mit der Wahrscheinlichkeit p = Pr(υν ≠ qν) = Pr(eν = 1) verfälscht, unabhängig von den Fehlerwahrscheinlichkeiten der benachbarten Symbole. Die (mittlere) Bitfehlerwahrscheinlichkeit pB ist somit ebenfalls gleich p.