Aufgabe 4.3: Iterative Decodierung beim BSC

Wir betrachten in dieser Aufgabe zwei Codes:

- den Single Parity–Code ⇒ SPC (3, 2, 2):

- $$\underline{x} = \big (\hspace{0.05cm}(0, 0, 0), \hspace{0.1cm} (0, 1, 1), \hspace{0.1cm} (1, 0, 1), \hspace{0.1cm} (1, 1, 0) \hspace{0.05cm} \big ) \hspace{0.05cm}, $$

- den Wiederholungscode ⇒ RC (3, 1, 3:

- $$\underline{x} = \big (\hspace{0.05cm}(0, 0, 0), \hspace{0.1cm} (1, 1, 1) \hspace{0.05cm} \big ) \hspace{0.05cm}.$$

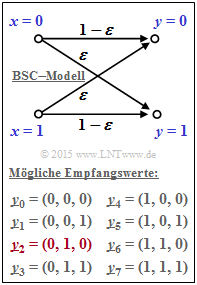

Der Kanal wird auf Bitebene durch das BSC–Modell beschrieben. Entsprechend der Grafik gilt dabei:

- $${\rm Pr}(y_i \ne x_i) \hspace{-0.15cm} \ = \ \hspace{-0.15cm}\varepsilon = 0.269\hspace{0.05cm},$$

- $${\rm Pr}(y_i = x_i) \hspace{-0.15cm} \ = \ \hspace{-0.15cm}1-\varepsilon = 0.731\hspace{0.05cm}.$$

Hierbei bezeichnet $\epsilon$ die Verfälschungswahrscheinlichkeit.

Bis auf die letzte Teilaufgabe wird stets von folgendem Empfangswert ausgegangen:

- $$\underline{y} = (0, 1, 0) =\underline{y}_2 \hspace{0.05cm}. $$

Die hier gewählte Indizierung aller möglichen Empfangsvektoren kann der Grafik entnommen werden. Der meist betrachtete Vektor $\underline{y}_2$ ist hierbei rot hervorgehoben. Für die Teilaufgabe (6) gilt dann:

- $$\underline{y} = (1, 1, 0) =\underline{y}_6 \hspace{0.05cm}. $$

Zur Decodierung sollen in der Aufgabe untersucht werden:

- die Syndromdecodierung, die bei den hier betrachteten Codes als Hard Decision Maximum Likelihood Detection (HD–ML) vornimmt. Hinweis: Softwerte liegen beim BSC nicht vor.

- die symbolweise Soft–in Soft–out Decodierung (SISO) entsprechend dieses Abschnitts.

Hinweise:

- Die Aufgabe bezieht sich auf das Kapitel Soft–in Soft–out Decoder.

- Das vom Decoder ausgewählte Codewort wird in den Fragen mit $\underline{z}$ bezeichnet.

- Sollte die Eingabe des Zahlenwertes „0” erforderlich sein, so geben Sie bitte „0.” ein.

Fragebogen

Musterlösung

Da der SPC (3, 2) zudem nur die minimale Distanz $d_{\rm min} = 2$ aufweist, kann auch kein Fehler korrigiert werden. Richtig ist somit der Lösungsvorschlag 3.

(2) Die möglichen Codeworte beim RP (3, 1) sind $\underline{x}_0 = (0, 0, 0)$ und $\underline{x}_1 = (1, 1, 1)$. Die minimale Distanz dieses Codes beträgt $d_{\rm min} = 3$; so dass $t = (d_{\rm min} \, –1)/2 = 1$ Fehler korrigiert werden kann. Neben $\underline{y}_0 = (0, 0, 0) werden auch die Empfangsworte $\underline{y}_1 = (0, 0, 1), \ \underline{y}_2 = (0, 1, 0)$ und $\underline{y}_4 = (1, 0, 0)$ dem Decodierergebnis $\underline{x}_0 = (0, 0, 0)$ zugeordnet ⇒ <u>Lösungsvorschlag 2</u>.

'''(3)''' Entsprechend dem BSC–Modell gilt für die bedingte Wahrscheinlichkeit, dass $\underline{y}_2 = (0, 1, 0)$ empfangen wird, unter der Voraussetzung, dass $\underline{x}_0 = (0, 0, 0)$ gesenet wurde:

:'"`UNIQ-MathJax29-QINU`"'

Der erste Term $(1 \, –\epsilon)^2$ gilt dabei die Wahrscheinlichkeit dafür an, dass das erste und das dritte Bit richtig übertragen wurden und $\epsilon$ berücksichtigt die Verfälschungswahrscheinlichkeit für das zweite Bit.

Entsprechend gilt für das zweite mögliche Codewort $\underline{x}_1 = (1, 1, 1)$:

:'"`UNIQ-MathJax30-QINU`"'

Nach dem Satz von Bayes gilt dann für die Rückschlusswahrscheinlichkeiten:

:'"`UNIQ-MathJax31-QINU`"'

:'"`UNIQ-MathJax32-QINU`"'

:'"`UNIQ-MathJax33-QINU`"'

Mit $\epsilon = 0.269$ erhält man folgende Zahlenwerte:

:'"`UNIQ-MathJax34-QINU`"'

'''(4)''' Das Vorzeichen des Kanal–$L$–Wertes $L_{\rm K}(i)$ ist positiv, falls $y_i = 0$, und negativ für $y_i = 1$. Der Betrag gibt die Zuverlässigkeit von $y_i$ an. Beim BSC–Modell gilt $|L_{\rm K}(i)| = \ln {(1 \, –\Epsilon)/\epsilon} = 1$ für alle $i$. Also:

(5)

(6)