Aufgaben:Aufgabe 3.7: Einige Entropieberechnungen: Unterschied zwischen den Versionen

Safwen (Diskussion | Beiträge) |

|||

| (19 dazwischenliegende Versionen von 2 Benutzern werden nicht angezeigt) | |||

| Zeile 3: | Zeile 3: | ||

}} | }} | ||

| − | [[Datei:P_ID2766__Inf_A_3_6.png|right|]] | + | [[Datei:P_ID2766__Inf_A_3_6.png|right|frame|Schaubild: <br>Entropien und Transinformation]] |

| − | Wir betrachten die beiden Zufallsgrößen $XY$ und $UV$ mit den folgenden 2D-Wahrscheinlichkeitsfunktionen: | + | Wir betrachten die beiden Zufallsgrößen $XY$ und $UV$ mit den folgenden 2D-Wahrscheinlichkeitsfunktionen: |

| + | :$$P_{XY}(X, Y) = \begin{pmatrix} 0.18 & 0.16\\ 0.02 & 0.64 \end{pmatrix}\hspace{0.05cm} \hspace{0.05cm}$$ | ||

| + | :$$P_{UV}(U, V) \hspace{0.05cm}= \begin{pmatrix} 0.068 & 0.132\\ 0.272 & 0.528 \end{pmatrix}\hspace{0.05cm}$$ | ||

| − | $$P_{XY}(X, Y) = \ | + | Für die Zufallsgröße $XY$ sollen in dieser Aufgabe berechnet werden: |

| + | * die Verbundentropie (englisch: "Joint Entropy"): | ||

| + | :$$H(XY) = -{\rm E}\big [\log_2 P_{ XY }( X,Y) \big ],$$ | ||

| + | * die beiden Einzelentropien: | ||

| + | :$$H(X) = -{\rm E}\big [\log_2 P_X( X)\big ],$$ | ||

| + | :$$H(Y) = -{\rm E}\big [\log_2 P_Y( Y)\big ].$$ | ||

| + | Daraus lassen sich gemäß dem obigen Schema – dargestellt für die Zufallsgröße $XY$ – auch folgende Beschreibungsgrößen sehr einfach bestimmen: | ||

| + | * die bedingten Entropien (englisch: "Conditional Entropies"): | ||

| + | :$$H(X \hspace{0.05cm}|\hspace{0.05cm} Y) = -{\rm E}\big [\log_2 P_{ X \hspace{0.05cm}|\hspace{0.05cm}Y }( X \hspace{0.05cm}|\hspace{0.05cm} Y)\big ],$$ | ||

| + | :$$H(Y \hspace{0.05cm}|\hspace{0.05cm} X) = -{\rm E}\big [\log_2 P_{ Y \hspace{0.05cm}|\hspace{0.05cm} X }( Y \hspace{0.05cm}|\hspace{0.05cm} X)\big ],$$ | ||

| + | * die Transinformation (englisch: "Mutual Information") zwischen $X$ und $Y$: | ||

| + | :$$I(X;Y) = {\rm E} \hspace{-0.08cm}\left [ \hspace{0.02cm}{\rm log}_2 \hspace{0.1cm} \frac{P_{XY}(X, Y)} | ||

| + | {P_{X}(X) \cdot P_{Y}(Y) }\right ] \hspace{0.05cm}.$$ | ||

| − | $$ | + | Abschließend sind qualitative Aussagen hinsichtlich der zweiten Zufallsgröße $UV$ zu verifizieren. |

| − | |||

| − | |||

| − | |||

| − | |||

| − | |||

| − | |||

| − | |||

| − | |||

| − | |||

| − | + | Hinweise: | |

| − | + | *Die Aufgabe gehört zum Kapitel [[Informationstheorie/Verschiedene_Entropien_zweidimensionaler_Zufallsgrößen|Verschiedene Entropien zweidimensionaler Zufallsgrößen]]. | |

| − | + | *Insbesondere wird Bezug genommen auf die Seiten <br> [[Informationstheorie/Verschiedene_Entropien_zweidimensionaler_Zufallsgrößen#Bedingte_Wahrscheinlichkeit_und_bedingte_Entropie|Bedingte Wahrscheinlichkeit und bedingte Entropie]] sowie <br> [[Informationstheorie/Verschiedene_Entropien_zweidimensionaler_Zufallsgrößen#Transinformation_zwischen_zwei_Zufallsgr.C3.B6.C3.9Fen|Transinformation zwischen zwei Zufallsgrößen]]. | |

| − | + | ||

| − | |||

| − | |||

| − | |||

| − | |||

| Zeile 40: | Zeile 41: | ||

{Berechnen Sie die Verbundentropie. | {Berechnen Sie die Verbundentropie. | ||

|type="{}"} | |type="{}"} | ||

| − | $H(XY)$ | + | $H(XY) \ = \ $ { 1.393 3% } $\ \rm bit$ |

| − | {Welche Entropien weisen die 1D–Zufallsgrößen $X$ und $Y$ auf? | + | {Welche Entropien weisen die 1D–Zufallsgrößen $X$ und $Y$ auf? |

|type="{}"} | |type="{}"} | ||

| − | $H(X)$ | + | $H(X) \ = \ $ { 0.722 3% } $\ \rm bit$ |

| − | $H(Y)$ | + | $H(Y) \ = \ $ { 0.925 3% } $\ \rm bit$ |

| − | {Wie groß ist die Transinformation zwischen den Zufallsgrößen $X$ und $Y$? | + | {Wie groß ist die Transinformation zwischen den Zufallsgrößen $X$ und $Y$? |

|type="{}"} | |type="{}"} | ||

| − | $I(X; Y)$ | + | $I(X; Y) \ = \ $ { 0.254 3% } $\ \rm bit$ |

{Berechnen Sie die beiden bedingten Entropien. | {Berechnen Sie die beiden bedingten Entropien. | ||

|type="{}"} | |type="{}"} | ||

| − | $H(X|Y)$ | + | $H(X|Y) \ = \ $ { 0.468 3% } $\ \rm bit$ |

| − | $H(Y|X)$ | + | $H(Y|X) \ = \ $ { 0.671 3% } $\ \rm bit$ |

| − | {Welche der folgenden Aussagen treffen für die 2D–Zufallsgröße $UV$ zu? | + | {Welche der folgenden Aussagen treffen für die 2D–Zufallsgröße $UV$ zu? |

|type="[]"} | |type="[]"} | ||

| − | + Die 1D–Zufallsgrößen $U$ und $V$ sind statistisch unabhängig. | + | + Die 1D–Zufallsgrößen $U$ und $V$ sind statistisch unabhängig. |

| − | + Die gemeinsame Information von $U$ und $V | + | + Die gemeinsame Information von $U$ und $V$ ist $I(U; V) = 0$. |

| − | - Für die Verbundentropie gilt $H(UV) = H(XY)$. | + | - Für die Verbundentropie gilt $H(UV) = H(XY)$. |

| − | + Es gelten die Beziehungen $H(U|V) = H(U)$ und $H(V|U) = H(V)$. | + | + Es gelten die Beziehungen $H(U|V) = H(U)$ und $H(V|U) = H(V)$. |

| Zeile 70: | Zeile 71: | ||

{{ML-Kopf}} | {{ML-Kopf}} | ||

| − | '''1 | + | '''(1)''' Aus der gegebenen Verbundwahrscheinlichkeit erhält man |

| + | |||

| + | :$$H(XY) = 0.18 \cdot {\rm log}_2 \hspace{0.1cm} \frac{1}{0.18} + 0.16\cdot {\rm log}_2 \hspace{0.1cm} \frac{1}{0.16}+ | ||

| + | 0.02\cdot {\rm log}_2 \hspace{0.1cm} \frac{1}{0.02}+ | ||

| + | 0.64\cdot {\rm log}_2 \hspace{0.1cm} \frac{1}{0.64} | ||

| + | \hspace{0.15cm} \underline {= 1.393\,{\rm (bit)}} | ||

| + | \hspace{0.05cm}.$$ | ||

| + | |||

| − | |||

| − | $$ | + | '''(2)''' Die 1D–Wahrscheinlichkeitsfunktionen lauten $P_X(X) = \big [0.2, \ 0.8 \big ]$ und $P_Y(Y) = \big [0.34, \ 0.66 \big ]$. Daraus folgt: |

| + | :$$H(X) = 0.2 \cdot {\rm log}_2 \hspace{0.1cm} \frac{1}{0.2} + 0.8\cdot {\rm log}_2 \hspace{0.1cm} \frac{1}{0.8}\hspace{0.15cm} \underline {= 0.722\,{\rm (bit)}} \hspace{0.05cm},$$ | ||

| + | :$$H(Y) =0.34 \cdot {\rm log}_2 \hspace{0.1cm} \frac{1}{0.34} + 0.66\cdot {\rm log}_2 \hspace{0.1cm} \frac{1}{0.66}\hspace{0.15cm} \underline {= 0.925\,{\rm (bit)}} \hspace{0.05cm}.$$ | ||

| − | |||

| − | $H(X) = 0 | + | '''(3)''' Aus der Grafik auf der Angabenseite erkennt man den Zusammenhang: |

| + | :$$I(X;Y) = H(X) + H(Y) - H(XY) = 0.722\,{\rm (bit)} + 0.925\,{\rm (bit)}- 1.393\,{\rm (bit)}\hspace{0.15cm} \underline {= 0.254\,{\rm (bit)}} \hspace{0.05cm}.$$ | ||

| − | |||

| − | |||

| − | $$ | + | '''(4)''' Ebenso gilt entsprechend der Grafik auf der Angabenseite: |

| − | $$ | + | :$$H(X \hspace{-0.1cm}\mid \hspace{-0.08cm} Y) = H(XY) - H(Y) = 1.393- 0.925\hspace{0.15cm} \underline {= 0.468\,{\rm (bit)}} \hspace{0.05cm},$$ |

| + | :$$H(Y \hspace{-0.1cm}\mid \hspace{-0.08cm} X) = H(XY) - H(X) = 1.393- 0.722\hspace{0.15cm} \underline {= 0.671\,{\rm (bit)}} \hspace{0.05cm}$$ | ||

| + | [[Datei:P_ID2767__Inf_A_3_6d.png|right|frame|Entropiewerte für die Zufallsgrößen $XY$ und $UV$]] | ||

| − | '''4 | + | *Die linke Grafik fasst die Ergebnisse der Teilaufgaben '''(1)''', ... , '''(4)''' maßstabsgetreu zusammen. |

| + | *Grau hinterlegt ist die Verbundentropie und gelb die Transinformation. | ||

| + | *Eine rote Hinterlegung bezieht sich auf die Zufallsgröße $X$, eine grüne auf $Y$. Schraffierte Felder deuten auf eine bedingte Entropie hin. | ||

| − | |||

| − | |||

| − | Die | + | Die rechte Grafik beschreibt den gleichen Sachverhalt für die Zufallsgröße $UV$ ⇒ Teilaufgabe '''(5)'''. |

| − | |||

| − | |||

| − | '''5 | + | '''(5)''' Richtig sind gemäß dem Schaubild die Aussagen 1, 2 und 4: |

| − | + | *Man erkennt die Gültigkeit von $P_{ UV } = P_U · P_V$ ⇒ Transinformation $I(U; V) = 0$ daran, <br>dass die zweite Zeile der $P_{ UV }$–Matrix sich von der ersten Zeile nur durch einen konstanten Faktor $(4)$ unterscheidet. | |

| − | + | *Es ergeben sich gleiche 1D–Wahrscheinlichkeitsfunktionen wie für die Zufallsgröße $XY$ ⇒ $P_U(U) = \big [0.2, \ 0.8 \big ]$ und $P_V(V) = \big [0.34, \ 0.66 \big ]$. | |

| − | + | *Deshalb ist auch $H(U) = H(X) = 0.722\ \rm bit$ und $H(V) = H(Y) = 0.925 \ \rm bit$. | |

| + | * Hier gilt aber nun für die Verbundentropie: $H(UV) = H(U) + H(V) ≠ H(XY)$. | ||

{{ML-Fuß}} | {{ML-Fuß}} | ||

| Zeile 108: | Zeile 116: | ||

| − | [[Category:Aufgaben zu Informationstheorie|^3. | + | [[Category:Aufgaben zu Informationstheorie|^3.2 Entropien von 2D-Zufallsgrößen^]] |

Aktuelle Version vom 1. September 2021, 11:46 Uhr

Wir betrachten die beiden Zufallsgrößen $XY$ und $UV$ mit den folgenden 2D-Wahrscheinlichkeitsfunktionen:

- $$P_{XY}(X, Y) = \begin{pmatrix} 0.18 & 0.16\\ 0.02 & 0.64 \end{pmatrix}\hspace{0.05cm} \hspace{0.05cm}$$

- $$P_{UV}(U, V) \hspace{0.05cm}= \begin{pmatrix} 0.068 & 0.132\\ 0.272 & 0.528 \end{pmatrix}\hspace{0.05cm}$$

Für die Zufallsgröße $XY$ sollen in dieser Aufgabe berechnet werden:

- die Verbundentropie (englisch: "Joint Entropy"):

- $$H(XY) = -{\rm E}\big [\log_2 P_{ XY }( X,Y) \big ],$$

- die beiden Einzelentropien:

- $$H(X) = -{\rm E}\big [\log_2 P_X( X)\big ],$$

- $$H(Y) = -{\rm E}\big [\log_2 P_Y( Y)\big ].$$

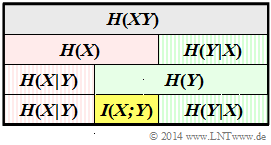

Daraus lassen sich gemäß dem obigen Schema – dargestellt für die Zufallsgröße $XY$ – auch folgende Beschreibungsgrößen sehr einfach bestimmen:

- die bedingten Entropien (englisch: "Conditional Entropies"):

- $$H(X \hspace{0.05cm}|\hspace{0.05cm} Y) = -{\rm E}\big [\log_2 P_{ X \hspace{0.05cm}|\hspace{0.05cm}Y }( X \hspace{0.05cm}|\hspace{0.05cm} Y)\big ],$$

- $$H(Y \hspace{0.05cm}|\hspace{0.05cm} X) = -{\rm E}\big [\log_2 P_{ Y \hspace{0.05cm}|\hspace{0.05cm} X }( Y \hspace{0.05cm}|\hspace{0.05cm} X)\big ],$$

- die Transinformation (englisch: "Mutual Information") zwischen $X$ und $Y$:

- $$I(X;Y) = {\rm E} \hspace{-0.08cm}\left [ \hspace{0.02cm}{\rm log}_2 \hspace{0.1cm} \frac{P_{XY}(X, Y)} {P_{X}(X) \cdot P_{Y}(Y) }\right ] \hspace{0.05cm}.$$

Abschließend sind qualitative Aussagen hinsichtlich der zweiten Zufallsgröße $UV$ zu verifizieren.

Hinweise:

- Die Aufgabe gehört zum Kapitel Verschiedene Entropien zweidimensionaler Zufallsgrößen.

- Insbesondere wird Bezug genommen auf die Seiten

Bedingte Wahrscheinlichkeit und bedingte Entropie sowie

Transinformation zwischen zwei Zufallsgrößen.

Fragebogen

Musterlösung

(1) Aus der gegebenen Verbundwahrscheinlichkeit erhält man

- $$H(XY) = 0.18 \cdot {\rm log}_2 \hspace{0.1cm} \frac{1}{0.18} + 0.16\cdot {\rm log}_2 \hspace{0.1cm} \frac{1}{0.16}+ 0.02\cdot {\rm log}_2 \hspace{0.1cm} \frac{1}{0.02}+ 0.64\cdot {\rm log}_2 \hspace{0.1cm} \frac{1}{0.64} \hspace{0.15cm} \underline {= 1.393\,{\rm (bit)}} \hspace{0.05cm}.$$

(2) Die 1D–Wahrscheinlichkeitsfunktionen lauten $P_X(X) = \big [0.2, \ 0.8 \big ]$ und $P_Y(Y) = \big [0.34, \ 0.66 \big ]$. Daraus folgt:

- $$H(X) = 0.2 \cdot {\rm log}_2 \hspace{0.1cm} \frac{1}{0.2} + 0.8\cdot {\rm log}_2 \hspace{0.1cm} \frac{1}{0.8}\hspace{0.15cm} \underline {= 0.722\,{\rm (bit)}} \hspace{0.05cm},$$

- $$H(Y) =0.34 \cdot {\rm log}_2 \hspace{0.1cm} \frac{1}{0.34} + 0.66\cdot {\rm log}_2 \hspace{0.1cm} \frac{1}{0.66}\hspace{0.15cm} \underline {= 0.925\,{\rm (bit)}} \hspace{0.05cm}.$$

(3) Aus der Grafik auf der Angabenseite erkennt man den Zusammenhang:

- $$I(X;Y) = H(X) + H(Y) - H(XY) = 0.722\,{\rm (bit)} + 0.925\,{\rm (bit)}- 1.393\,{\rm (bit)}\hspace{0.15cm} \underline {= 0.254\,{\rm (bit)}} \hspace{0.05cm}.$$

(4) Ebenso gilt entsprechend der Grafik auf der Angabenseite:

- $$H(X \hspace{-0.1cm}\mid \hspace{-0.08cm} Y) = H(XY) - H(Y) = 1.393- 0.925\hspace{0.15cm} \underline {= 0.468\,{\rm (bit)}} \hspace{0.05cm},$$

- $$H(Y \hspace{-0.1cm}\mid \hspace{-0.08cm} X) = H(XY) - H(X) = 1.393- 0.722\hspace{0.15cm} \underline {= 0.671\,{\rm (bit)}} \hspace{0.05cm}$$

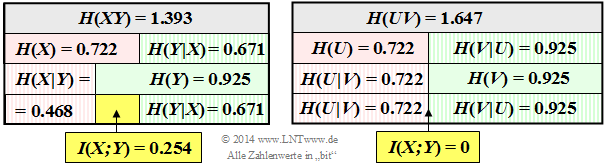

- Die linke Grafik fasst die Ergebnisse der Teilaufgaben (1), ... , (4) maßstabsgetreu zusammen.

- Grau hinterlegt ist die Verbundentropie und gelb die Transinformation.

- Eine rote Hinterlegung bezieht sich auf die Zufallsgröße $X$, eine grüne auf $Y$. Schraffierte Felder deuten auf eine bedingte Entropie hin.

Die rechte Grafik beschreibt den gleichen Sachverhalt für die Zufallsgröße $UV$ ⇒ Teilaufgabe (5).

(5) Richtig sind gemäß dem Schaubild die Aussagen 1, 2 und 4:

- Man erkennt die Gültigkeit von $P_{ UV } = P_U · P_V$ ⇒ Transinformation $I(U; V) = 0$ daran,

dass die zweite Zeile der $P_{ UV }$–Matrix sich von der ersten Zeile nur durch einen konstanten Faktor $(4)$ unterscheidet. - Es ergeben sich gleiche 1D–Wahrscheinlichkeitsfunktionen wie für die Zufallsgröße $XY$ ⇒ $P_U(U) = \big [0.2, \ 0.8 \big ]$ und $P_V(V) = \big [0.34, \ 0.66 \big ]$.

- Deshalb ist auch $H(U) = H(X) = 0.722\ \rm bit$ und $H(V) = H(Y) = 0.925 \ \rm bit$.

- Hier gilt aber nun für die Verbundentropie: $H(UV) = H(U) + H(V) ≠ H(XY)$.