Aufgaben:Aufgabe 4.4: Maximum–a–posteriori und Maximum–Likelihood: Unterschied zwischen den Versionen

| Zeile 23: | Zeile 23: | ||

:$$\hat{m}_{\rm MAP} = {\rm arg} \max_i \hspace{0.1cm} [ {\rm Pr}( s = s_i) \cdot p_{r |s } \hspace{0.05cm} (\rho | :$$\hat{m}_{\rm MAP} = {\rm arg} \max_i \hspace{0.1cm} [ {\rm Pr}( s = s_i) \cdot p_{r |s } \hspace{0.05cm} (\rho | ||

|s_i ) ]\hspace{0.05cm}.$$ | |s_i ) ]\hspace{0.05cm}.$$ | ||

| + | |||

| + | |||

| + | ''Hinweise:'' | ||

| + | *Die Aufgabe gehört zum Kapitel [[Digitalsignal%C3%BCbertragung/Signale,_Basisfunktionen_und_Vektorr%C3%A4ume| Signale, Basisfunktionen und Vektorräume]]. | ||

| + | *Sollte die Eingabe des Zahlenwertes „0” erforderlich sein, so geben Sie bitte „0.” ein. | ||

''Hinweise:'' | ''Hinweise:'' | ||

Version vom 9. November 2017, 13:44 Uhr

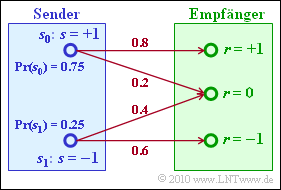

Zur Verdeutlichung von MAP– und ML–Entscheidung konstruieren wir nun ein sehr einfaches Beispiel mit nur zwei möglichen Nachrichten $m_0 = 0$ und $m_1 = 1$, die durch die Signalwerte $s_0$ bzw. $s_1$ dargestellt werden:

- $$s \hspace{-0.15cm} \ = \ \hspace{-0.15cm}s_0 = +1 \hspace{0.2cm} \Longleftrightarrow \hspace{0.2cm}m = m_0 = 0\hspace{0.05cm},$$

- $$s \hspace{-0.15cm} \ = \ \hspace{-0.15cm}s_1 = -1 \hspace{0.2cm} \Longleftrightarrow \hspace{0.2cm}m = m_1 = 1\hspace{0.05cm}.$$

Die Auftrittswahrscheinlichkeiten sind:

- $${\rm Pr}(s = s_0) = 0.75,\hspace{0.2cm}{\rm Pr}(s = s_1) = 0.25 \hspace{0.05cm}.$$

Das Empfangssignal kann – warum auch immer – drei verschiedene Werte annehmen, nämlich

- $$r = +1,\hspace{0.2cm}r = 0,\hspace{0.2cm}r = -1 \hspace{0.05cm}.$$

Die bedingten Kanalwahrscheinlichkeiten können der Grafik entnommen werden.

Nach der Übertragung soll die gesendete Nachricht durch einen optimalen Empfänger geschätzt werden. Zur Verfügung stehen:

- der Maximum–Likelihood–Empfänger (ML–Empfänger), der die Auftrittswahrscheinlichkeiten ${\rm Pr}(s = s_i)$ nicht kennt, mit der Entscheidungsregel:

- $$\hat{m}_{\rm ML} = {\rm arg} \max_i \hspace{0.1cm} [ p_{r |s } \hspace{0.05cm} (\rho |s_i ) ]\hspace{0.05cm},$$

- der Maximum–a–posteriori–Empfänger (MAP–Empfänger); dieser berücksichtigt bei seinem Entscheidungsprozess auch die Symbolwahrscheinlichkeiten der Quelle:

- $$\hat{m}_{\rm MAP} = {\rm arg} \max_i \hspace{0.1cm} [ {\rm Pr}( s = s_i) \cdot p_{r |s } \hspace{0.05cm} (\rho |s_i ) ]\hspace{0.05cm}.$$

Hinweise:

- Die Aufgabe gehört zum Kapitel Signale, Basisfunktionen und Vektorräume.

- Sollte die Eingabe des Zahlenwertes „0” erforderlich sein, so geben Sie bitte „0.” ein.

Hinweise:

- Diese Aufgabe bezieht sich auf das Kapitel Optimale Empfängerstrategien sowie das Kapitel Struktur des optimalen Empfängers des vorliegenden Buches.

- Die notwendigen statistischen Grundlagen finden Sie im Kapitel Statistische Abhängigkeit und Unabhängigkeit des Buches „Stochastische Signaltheorie”.

Fragebogen

Musterlösung

- $${\rm Pr} ( r = +1) \hspace{-0.1cm} \ = \ \hspace{-0.1cm} {\rm Pr} ( s_0) \cdot {\rm Pr} ( r = +1 \hspace{0.05cm}| \hspace{0.05cm}s = +1) = 0.75 \cdot 0.8 \hspace{0.05cm}\hspace{0.15cm}\underline { = 0.6}\hspace{0.05cm},$$

- $${\rm Pr} ( r = -1) \hspace{-0.1cm} \ = \ \hspace{-0.1cm} {\rm Pr} ( s_1) \cdot {\rm Pr} ( r = -1 \hspace{0.05cm}| \hspace{0.05cm}s = -1) = 0.25 \cdot 0.6 \hspace{0.05cm}\hspace{0.15cm}\underline {= 0.15}\hspace{0.05cm},$$

- $${\rm Pr} ( r = 0) \hspace{-0.1cm} \ = \ \hspace{-0.1cm} 1 - {\rm Pr} ( r = +1) - {\rm Pr} ( r = -1) = 1 - 0.6 - 0.15 \hspace{0.05cm}\hspace{0.15cm}\underline {= 0.25}\hspace{0.05cm}.$$

Für die letzte Wahrscheinlichkeit gilt auch:

- $${\rm Pr} ( r = 0) = 0.75 \cdot 0.2 + 0.25 \cdot 0.4 = 0.25\hspace{0.05cm}.$$

(2) Für die erste gesuchte Rückschlusswahrscheinlichkeit gilt:

- $${\rm Pr} (s_0 \hspace{0.05cm}| \hspace{0.05cm}r = +1) = \frac{{\rm Pr} ( r = +1 \hspace{0.05cm}|\hspace{0.05cm}s_0 ) \cdot {\rm Pr} ( s_0)}{{\rm Pr} ( r = +1)} = \frac{0.8 \cdot 0.75}{0.6} \hspace{0.05cm}\hspace{0.15cm}\underline {= 1}\hspace{0.05cm}.$$

Entsprechend erhält man für die weiteren Wahrscheinlichkeiten:

- $${\rm Pr} (s_1 \hspace{0.05cm}| \hspace{0.05cm}r = +1) \hspace{-0.1cm} \ = \ 1 - {\rm Pr} (s_0 \hspace{0.05cm}| \hspace{0.05cm}r = +1) \hspace{0.05cm}\hspace{0.15cm}\underline {= 0}\hspace{0.05cm},$$

- $${\rm Pr} (s_0 \hspace{0.05cm}| \hspace{0.05cm}r = -1) \hspace{-0.1cm} \ = \ \hspace{-0.1cm} 0, \hspace{0.4cm}{\rm Pr} (s_1 \hspace{0.05cm}| \hspace{0.05cm}r = -1) \hspace{0.05cm}\hspace{0.15cm}\underline {= 1}\hspace{0.05cm},$$

- $${\rm Pr} (s_0 \hspace{0.05cm}| \hspace{0.05cm}r = 0) \hspace{-0.1cm} \ = \ \hspace{-0.1cm}\frac{{\rm Pr} ( r = 0 \hspace{0.05cm}|\hspace{0.05cm}s_0 ) \cdot {\rm Pr} ( s_0)}{{\rm Pr} ( r = 0 )}= \frac{0.2 \cdot 0.75}{0.25} \hspace{0.05cm}\hspace{0.15cm}\underline {= 0.6}\hspace{0.05cm},$$

- $${\rm Pr} (s_1 \hspace{0.05cm}| \hspace{0.05cm}r = 0) \hspace{-0.1cm} \ = \ \hspace{-0.1cm} 1- {\rm Pr} (s_0 \hspace{0.05cm}| \hspace{0.05cm}r = 0) \hspace{0.05cm}\hspace{0.15cm}\underline {= 0.4} \hspace{0.05cm}.$$

(3) Es gelte $r = +1$. Dann entscheidet sich

- der MAP–Empfänger für $s_0$, da

- $${\rm Pr} (s_0 \hspace{0.05cm}| \hspace{0.05cm}r = +1) = 1 > {\rm Pr} (s_1 \hspace{0.05cm}| \hspace{0.05cm}r = +1)= 0\hspace{0.05cm},$$

- der ML–Empfänger ebenfalls für $s_0$, da

- $${\rm Pr} ( r = +1 \hspace{0.05cm}| \hspace{0.05cm}s_0) = 0.8 > {\rm Pr} ( r = +1 \hspace{0.05cm}| \hspace{0.05cm}s_1) = 0 \hspace{0.05cm}.$$

Richtig ist also NEIN.

(4) Zum gleichen Ergebnis NEIN kommt man unter der Voraussetzung „$r = \, –1$”, da keine Verbindung zwischen $s_0$ und „$r = \, –1$” besteht.

(5) Der MAP–Empfänger entscheidet sich für das Ereignis $s_0$, da

- $${\rm Pr} (s_0 \hspace{0.05cm}| \hspace{0.05cm}r = 0) = 0.6 > {\rm Pr} (s_1 \hspace{0.05cm}| \hspace{0.05cm}r = 0) = 0.4 \hspace{0.05cm}.$$

Dagegen wird sich der ML–Empfänger für $s_1$ entscheiden, da

- $${\rm Pr} ( r = 0 \hspace{0.05cm}| \hspace{0.05cm}s_1) = 0.4 > {\rm Pr} ( r = 0 \hspace{0.05cm}| \hspace{0.05cm}s_0) = 0.2 \hspace{0.05cm}.$$

Richtig sind also die Lösungsvorschläge 1 und 4.

(6) Der Maximum–Likelihood–Empfänger

- entscheidet sich nur für $s_0$, wenn $r = +1$ ist,

- macht also keinen Fehler, wenn $s_1$ gesendet wurde,

- macht nur einen Fehler bei der Kombination „$s_0$” und „$r = 0$”:

- $${\rm Pr} ({\rm Symbolfehler} ) = {\rm Pr} ({\cal E } ) = 0.75 \cdot 0.2 \hspace{0.05cm}\hspace{0.15cm}\underline {= 0.15} \hspace{0.05cm}.$$

(7) Der MAP–Empfänger entscheidet sich dagegen bei „$r = 0$” für $s_0$. Einen Symbolfehler gibt es also nur in der Kombination „$s_1$” und „$r = 0$”. Daraus folgt:

- $${\rm Pr} ({\rm Symbolfehler} ) = {\rm Pr} ({\cal E } ) = 0.25 \cdot 0.4 \hspace{0.05cm}\hspace{0.15cm}\underline {= 0.1} \hspace{0.05cm}.$$

Die Fehlerwahrscheinlichkeit ist hier geringer als beim ML–Empfänger, da nun auch die unterschiedlichen Apriori–Wahrscheinlichkeiten ${\rm Pr}(s_0)$ und ${\rm Pr}(s_1)$ berücksichtigt werden.