Korrelation und Regressionsgerade

Inhaltsverzeichnis

Programmbeschreibung

Theoretischer Hintergrund

Erwartungswerte von 2D–Zufallsgrößen und Korrelationskoeffizient

Wir betrachten eine zweidimensionale (2D)–Zufallsgröße (X, Y) mit der Wahrscheinlichkeitsdichtefunktion (WDF) fXY(x,y), wobei zwischen den Einzelkomponenten X und Y statistische Abhängigkeiten bestehen. Ein Sonderfall ist die Korrelation.

Definition: Unter Korrelation versteht man eine lineare Abhängigkeit zwischen den Einzelkomponenten X und Y.

- Korrelierte Zufallsgrößen sind damit stets auch statistisch abhängig.

- Aber nicht jede statistische Abhängigkeit bedeutet gleichzeitig eine Korrelation.

Für das Folgende setzen wir voraus, dass X und Y mittelwertfrei seien ⇒ E[X]=E[Y]=0. Zur Beschreibung der Korrelation genügen dann folgende Erwartungswerte:

- die Varianzen in X– bzw. in Y–Richtung:

- σ2X=E[X2]=∫+∞−∞x2⋅fX(x)dx,σ2Y=E[Y2]=∫+∞−∞y2⋅fY(y)dy;

- die Kovarianz zwischen den Einzelkomponenten X und Y:

- μXY=E[X⋅Y]=∫+∞−∞∫+∞−∞x ⋅y⋅fXY(x,y)dxdy.

Bei statististischer Unabhängigkeit der beiden Komponenten X und Y ist die Kovarianz μXY≡0.

- Das Ergebnis μXY=0 ist auch bei statistisch abhängigen Komponenten X und Y möglich, nämlich dann, wenn diese unkorreliert, also linear unabhängig sind.

- Die statistische Abhängigkeit ist dann nicht von erster, sondern von höherer Ordnung, zum Beispiel entsprechend der Gleichung Y=X2.

Man spricht dann von vollständiger Korrelation, wenn die (deterministische) Abhängigkeit zwischen X und Y durch die Gleichung Y=K·X ausgedrückt wird.

Dann ergibt sich für die Kovarianz:

- μXY=σX·σY bei positivem Wert von K,

- μXY=−σX·σY bei negativem K–Wert.

Deshalb verwendet man häufig als Beschreibungsgröße anstelle der Kovarianz den so genannten Korrelationskoeffizienten.

Definition: Der Korrelationskoeffizient ist der Quotient aus der Kovarianz μXY und dem Produkt der Effektivwerte σX und σY der beiden Komponenten:

- ρXY=μXYσX⋅σY.

Der Korrelationskoeffizient ρXY weist folgende Eigenschaften auf:

- Aufgrund der Normierung gilt stets −1≤ρXY≤+1.

- Sind die beiden Zufallsgrößen X und Y unkorreliert, so ist ρXY=0.

- Bei strenger linearer Abhängigkeit zwischen X und Y ist ρXY=±1 ⇒ vollständige Korrelation.

- Ein positiver Korrelationskoeffizient bedeutet, dass bei größerem X–Wert im statistischen Mittel auch Y größer ist als bei kleinerem X.

- Dagegen drückt ein negativer Korrelationskoeffizient aus, dass Y mit steigendem X im Mittel kleiner wird.

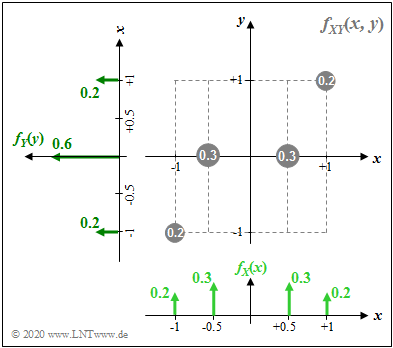

Beispiel 1: Die 2D–Zufallsgröße (X, Y) sei diskret und kann nur vier verschiedene Werte annehmen:

- (+0.5, 0) sowie (−0.5, 0) jeweils mit der Wahrscheinlichkeit 0.3,

- (+1, +1) sowie (−1, −1) jeweils mit der Wahrscheinlichkeit 0.2.

(A) Die Varianzen bzw. die Streuungen können aus fX(x) und fY(y) berechnet werden:

- σ2X=2⋅[0.2⋅12+0.3⋅0.52]=0.55⇒σX=0.7416,

- σ2Y=[0.2⋅(−1)2+0.6⋅02+0.2⋅(+1)2]=0.4⇒σY=0.6325.

(B) Für die Kovarianz ergibt sich der folgende Erwartungswert:

- μXY=E[X⋅Y]=2⋅[0.2⋅1⋅1+0.3⋅0.5⋅0]=0.4.

(C) Damit erhält man für den Korrelationskoeffizienten:

- ρXY=μXYσX⋅σY=0.40.7416⋅0.6325≈0.8528.

Regressionsgerade

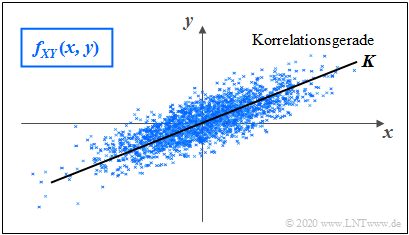

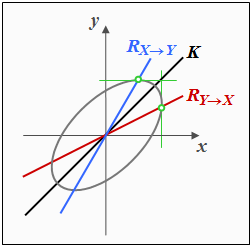

Ziel der linearen Regression ist es, einen einfachen (linearen) Zusammenhang zwischen zwei Zufallsgrößen X und Y zu anzugeben, deren 2D-WDF fXY(x,y) durch Punkte (x1,y1) ... (xN,yN) in der (x, y)–Ebene vorgegeben ist. Die Skizze zeigt das Prinzip am Beispiel mittelwertfreier Größen:

- Gesucht ist die Gleichung der Geraden K ⇒ y=copt⋅x mit der Eigenschaft, dass der mittlere quadratische (Euklidische) Abstand (MQA) aller Punkte von dieser Geraden minimal ist. Man bezeichnet diese Gerade auch als Korrelationsgerade. Diese kann als eine Art „statistische Symmetrieachse“ interpretiert werden.

Bei einer großen Menge N empirischer Daten ist der mathematische Aufwand beträchtlich, den bestmöglichen Parameter C=copt zu ermitteln. Der Aufwand wird deutlich reduziert, wenn man den Abstand nur in x– oder in y–Richtung definiert.

Im Sonderfall Gaußscher 2D-Zufallsgrößen wie in der Skizze verwendet ist die Korrelationsgerade K identisch mit der Ellipsenhauptachse bei Darstellung der 2D-WDF in Form von Höhenlinien.

Stimmt das?

(a)Regressionsgerade RY→X (rote Gerade in der App)

Hier wird der y–Wert auf den x–Wert zurückgeführt, was in etwa einer der möglichen Bedeutungen „Zurückfallen” des Wortes „Regression” entspricht.

- Geradengleichung, Winkel θY→X der Geraden RY→X zur x–Achse:

- y=CY→X⋅x mit CY→X=σYσX⋅ρXY=μXYσ2X,θY→X=arctan (CY→X).

- Kriterium: Der mittlere Abstand aller Punkte (xn,yn) von der Regressionsgeraden RY→X in y–Richtung ist minimal:

- MQAY=E[yn−CY→X⋅xn]2=1N⋅N∑n=1[yn−CY→X⋅xn]2=Minimum.

- Die zweite Gleichung gilt nur, wenn alle Punkte (xn,yn) der 2D–WDF gleichwahrscheinlich sind.

(b)Regressionsgerade RX→Y (blaue Gerade in der App)

Die Regression in Gegenrichtung (also von X auf Y) bedeutet dagegen, dass der x–Wert auf den y–Wert zurückgeführt wird. Für MQAY ergibt sich der minimale Wert.

- Geradengleichung, Winkel θX→Y der Geraden RX→Y zur x–Achse:

- y=CX→Y⋅x mit CX→Y=σXσY⋅ρXY=μXYσ2Y,θX→Y=arctan (CX→Y).

- Kriterium: Der mittlere Abstand aller Punkte (xn,yn) von der Regressionsgeraden RX→Y in x–Richtung ist minimal:

- MQAX=E[xn−yn/Cx→y]2=1N⋅N∑n=1[xn−yn/Cx→y]2=Minimum.

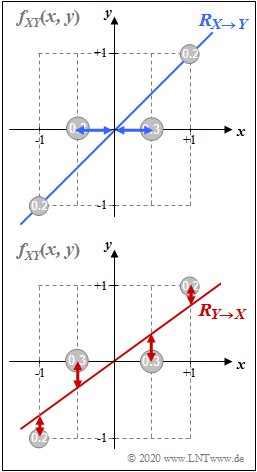

Beispiel 2: Es gelten die gleichen Voraussetzungen wie im Beispiel 1 und es werden teilweise auch die dort gefundenen Ergebnisse verwendet.

In der oberen Grafik ist die Regressionsgerade Rx→y als blaue Kurve eingezeichnet:

- Hierfür ergibt sich CX→Y=μXY/σ2Y=1 und dementsprechend θX→Y=arctan (1)=45∘.

- Für den mittleren Abstand aller vier Punkte (xn,yn) von der Regressionsgeraden RX→Y in x–Richtung erhält man unter Ausnutzung der Symmetrie (beachten Sie die eingezeichneten blauen Horizontalen):

- MQAX=E[xn−yn/Cx→y]2=2⋅[0.2⋅[1−1/1]2+0.3⋅[0.5−0/1]2]=0.15.

- Jede Gerade mit einem anderen Winkel als 45∘ führt hier zu einem größeren MQAX.

Betrachten wir nun die rote Regressionsgerade RY→X in der unteren Grafik.

- Hierfür ergibt sich CY→X=μXY/σ2X=0.4/0.55≈0.727 und θY→X=arctan (0.727)≈36∘.

- Hier ist nun der mittlere Abstand der vier Punkte (xn,yn) von der Regressionsgeraden RY→X in y–Richtung minimal (beachten Sie die eingezeichneten roten Vertikalen):

- MQAY=E[yn−Cy→x⋅xn]2=2⋅[0.2⋅[1−0.727⋅1]2+0.3⋅[0−0.727⋅0.5]2]≈0.109.

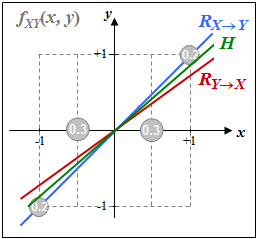

Die im Text erwähnte „Korrelationsgerade” mit der Eigenschaft, dass der mittlere quadratische Euklidische Abstand (MQA) aller Punkte von dieser Geraden minimal ist, wird sicher zwischen den beiden hier berechneten Regressionsgeraden liegen.

Testbereich

Bitte überprüfen

- Hier habe ich als Test neben der roten und der blauen Geraden noch die grüne Gerade H mit Winkel arctan(ρ)=arctan(0.853)≈40∘ eingezeichnet.

- Sollte das die Korrelationsgerade K sein, dann müsste der mittlere quadratische (Euklidische) Abstand (MQA) aller Punkte von dieser Geraden minimal sein.

- Müsste dann für diese Gerade MQA=MQAX+MQAY minimal sein?

- Bitte für mehrere Parametersätze überprüfen. Ich hoffe, dass das nicht allgemein stimmt.

Bitte recherchieren. Das kann man mit dem Programm nicht überprüfen

- Könnte das wenigstens bei Gaußschen 2D–Zufallsgrößen gelten

- Durch die Tangenten sind die Regressionsgeraden bestimmt.

- Im anderen LNTwww und im Carolin-Programm bezeichnen wir die schwarze Gerade als Ellipsenhauptache und die rote Gerade als Korrelationsgerade.

- Wenn das stimmt, müsste ich das ändern. Die Änderungen im Programm selbst wären minimal.

Der Sonderfall Gaußscher 2D–Zufallsgrößen

Fehlt noch.

Versuchsdurchführung

Eventuell noch überarbeiten

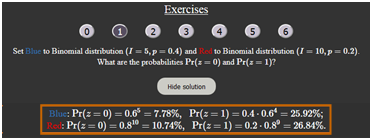

- Wählen Sie zunächst die Nummer 1 ... 6 der zu bearbeitenden Aufgabe.

- Eine Aufgabenbeschreibung wird angezeigt. Die Parameterwerte sind angepasst.

- Lösung nach Drücken von „Hide solution”.

- Aufgabenstellung und Lösung in Englisch.

Die Nummer 0 entspricht einem „Reset”:

- Gleiche Einstellung wie beim Programmstart.

- Ausgabe eines „Reset–Textes” mit weiteren Erläuterungen zum Applet.

Ende Überarbeitung Voreinstellung für Nummer 0 wie bei den Beispielen vorne

In den folgenden Aufgabenbeschreibungen werden folgende Kurzbezeichnungen verwendet:

- Rot: Regressionsgerade RY→X (im Applet rot gezeichnet),

- Blau: Regressionsgerade RX→Y (im Applet blau gezeichnet).

(1) Mit welcher Parametereinstellung sind die beiden Regressionsgerade RY→X und RX→Y deckungsgleich?

- Es ist offensichtlich, dass gleiche Regressionsgerade nur möglich sind, wenn diese unter dem Winkel 45∘ verlaufen ⇒ „Winkelhalbierende”.

- Da die fest vorgegebenen Punkte 3 und 4 auf der Winkelhalbierenden liegen, muss dies auch für die Punkte 1 und 2 gelten ⇒ y1=x1.

- Dies gilt für alle Parametereinstellungen y1=x1 und auch für alle p1 im erlaubten Bereich von 0 bis 0.5.

(2) Nun gelte x1=0.5, y1=0, p1=0.3 Interpretieren Sie die Ergebnisse. Aktivieren Sie hierzu die Hilfsgerade.

- Diese Einstellung stimmt mit den Voraussetzungen von Beispiel 1 und Beispiel 2 überein. Insbesondere gilt θX→Y=45∘. und θY→X≈36∘.

- Durch Variation des Winkels θH erkennt man, dass tatsächlich für θH=45∘ die Kenngröße MQAX=0.15 den kleinsmöglichen Wert annimmt.

- Ebenso ergibt sich der kleinsmöglicher Abstand MQAY=0.109 in y–Richtung für θH=36∘, also entsprechend der Regressionsgeraden Ry→x.

(3) Es gelten zunächst weiter die Einstellungen von (2). Wie ändern sich die Ergebnisse nach Variation des Parameters p1 im erlaubten Bereich (0≤p1≤0.5)?

- Die blaue Regressionsgerade verläuft weiter unter dem Winkel θX→Y=45∘. Das heißt: es gilt hier μXY=σ2Y, und zwar unabhängig von p1<0.5.

- Im Grenzfall p1=0.5 ist wegen σY=0 die blaue Regressionsgerade undefiniert. Es handelt sich nurmehr um eine 1D–Zufallsgröße X.

- Mit p1=0 sind nur die äußeren Punkte 3 und 4 wirksam ⇒ θY→X=θX→Y=45∘, mit p1=0.5 nur die inneren Punkte 1 und 2 ⇒ θY→X=0∘.

- Dazwischen wird die rote Regressionsgerade kontinuierlich flacher. Sind alle Punkte gleichwahrscheinlich (p1=0.25), dann ist θY→X≈38.7∘.

(4) Nun gelte x1=0, y1=0.5, p1=0.3. Variieren Sie p1 im Bereich 0≤p1<0.5 und interpretieren Sie die Ergebnisse. (p1=0.5 sollte man ausschließen).

- Wegen σX≤σY liegt weiterhin die blaue Gerade nie unterhalb der roten, die nun für alle p1≠0.5 die Winkelhalbierende ist ⇒ θY→X≈45∘.

- Der Winkel der blauen Regressionsgerade wächst von θX→Y=45∘ (p1=0) bis θX→Y→45∘ (p1→0.5) kontinuierlich an.

(5) Beginnen Sie mit x1=0.8, y1=−0.8, p1=0.25 und vergrößern Sie y1 bis zum Endwert y1=+0.8. Interpretieren Sie die Ergebnisse.

- Für y1=−0.8 ist θX→Y=77.6∘ und θY→X=12.4∘. Mit steigendem y1 verläuft die blaue Gerade RX→Y flacher und die rote (RY→X) steiler.

- Im Endpunkt (y1=+0.8) verlaufen die beiden Regressionsgeraden deckungsgleich unter dem Winkel θX→Y=θY→X=45∘.

(6) Abschließend gelte x1=+1, y1=−1. Variieren Sie p1 im gesamten zulässigen Bereich 0≤p1≤0.5. Wann sind die beiden Zufallsgrößen unkorreliert?

- Für p1=0 gilt θX→Y=θY→X=45∘. Anschließend dreht die blaue Gerade entgegen dem Uhrzeigersinn und die rote Gerade im Uhrzeigersinn.

- Für p1=0.25 sind die Winkel θX→Y=90∘, θY→X=0∘. Diese Momentaufnahme trifft genau den Fall unkorrelierter Zufallsgrößen ⇒ μXY=0.

- Anschließend drehen beide Geraden weiter in gleicher Richtung. Für p1=0.5 gilt schließlich: θX→Y=135∘=−45∘, θY→X=−45∘.

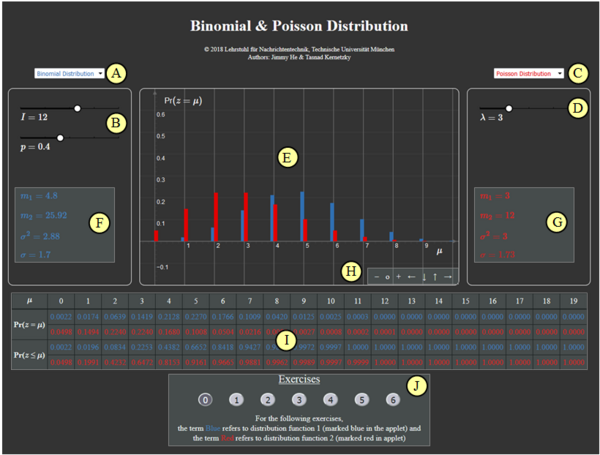

Zur Handhabung des Applets

(A) Vorauswahl für blauen Parametersatz

(B) Parametereingabe I und p per Slider

(C) Vorauswahl für roten Parametersatz

(D) Parametereingabe λ per Slider

(E) Graphische Darstellung der Verteilungen

(F) Momentenausgabe für blauen Parametersatz

(G) Momentenausgabe für roten Parametersatz

(H) Variation der grafischen Darstellung

„+” (Vergrößern),

„−” (Verkleinern)

„o” (Zurücksetzen)

„←” (Verschieben nach links), usw.

( I ) Ausgabe von Pr(z=μ) und Pr(z≤μ)

(J) Bereich für die Versuchsdurchführung

Andere Möglichkeiten zur Variation der grafischen Darstellung:

- Gedrückte Shifttaste und Scrollen: Zoomen im Koordinatensystem,

- Gedrückte Shifttaste und linke Maustaste: Verschieben des Koordinatensystems.

Über die Autoren

Dieses interaktive Berechnungstool wurde am Lehrstuhl für Nachrichtentechnik der Technischen Universität München konzipiert und realisiert.

- Die erste Version wurde 2005 von Bettina Hirner im Rahmen ihrer Diplomarbeit mit „FlashMX–Actionscript” erstellt (Betreuer: Günter Söder).

- 2020 wurde das Programm von Veronika Hofmann (Ingenieurspraxis Mathematik, Betreuer: Benedikt Leible und Tasnád Kernetzky ) unter „HTML5” neu gestaltet.